Interview: KI in der Softwareentwicklung – vom Hype zur produktiven Nutzung

Wie verändert KI die Softwareentwicklung? Experten von Consileon erklären Chancen, Grenzen und wie Unternehmen KI erfolgreich im Alltag einsetzen.

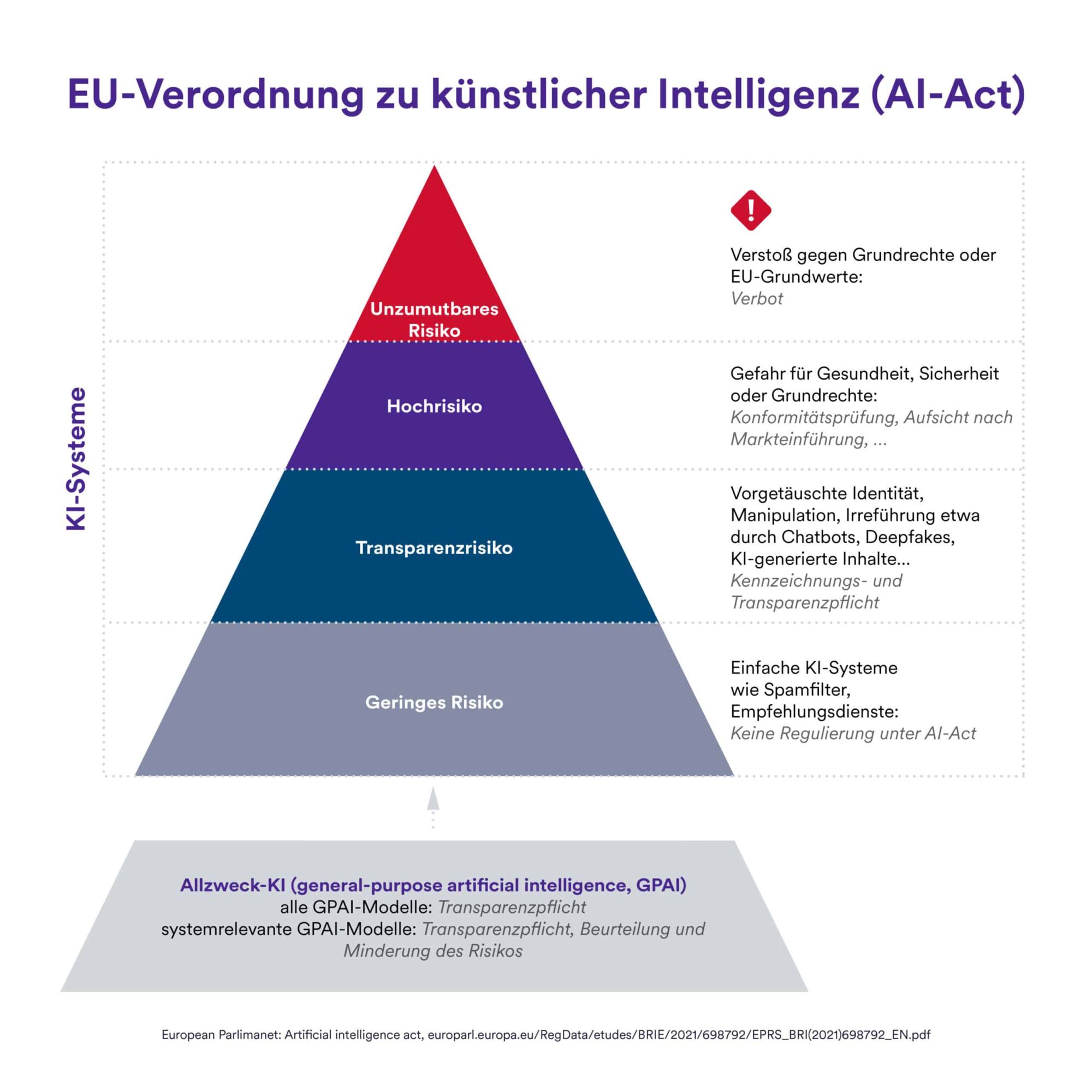

Im März 2024 hat das EU-Parlament eine Verordnung verabschiedet, die den öffentlichen und kommerziellen Einsatz solcher Systeme reguliert. Das auch als KI-Gesetz oder EU AI-Act bekannte Regelwerk teilt KI-Systeme in vier Risikoklassen ein. Je höher das Risiko, desto strenger die Auflagen. Die Verordnung tritt voraussichtlich Mitte des Jahres in Kraft, einzelne Vorschriften gelten bereits sechs Monate später.

Der EU AI-Act soll Menschen, Institutionen und Umwelt vor Risiken des staatlichen oder kommerziellen KI-Einsatzes schützen und dafür sorgen, dass KI-Systeme sicher, transparent, egalitär und umweltfreundlich arbeiten.

Klasse 1: Unzumutbares Risiko

Unzumutbar oder untragbar riskante KI-Apps verbietet die Verordnung. Darunter fallen Systeme, die implizit Grundrechte verletzen, etwa indem sie menschliche Schwächen zur Verhaltensmanipulation ausnutzen, Menschen nach biometrischen oder sozialen Merkmalen selektieren (Social Scoring), anlasslos überwachen oder verdächtigen. Dies erstreckt sich auch auf eigenmächtiges, wahlloses Auslesen und Sammeln von Gesichtern aus Online-Bildmaterial oder Überwachungskameras sowie auf die maschinelle Interpretation menschlicher Emotionen am Arbeitsplatz oder in Bildungseinrichtungen. Nur amtliche Strafverfolger genießen hier – streng reglementierte – Sonderbefugnisse.

Klasse 2: Hochrisikosysteme

Hochriskant sind KI-Systeme, deren Einsatz zwar nicht automatisch die Gesundheit, Sicherheit, Grundrechte, Umwelt, Demokratie oder den Rechtsstaat schädigt, die aber für vorsätzlichen oder fahrlässigen Missbrauch anfällig sind. Typischerweise dienen sie der Verwaltung kritischer Infrastruktur, materieller oder ideeller Ressourcen oder von Personal.

Mehr anzeigenSolche Systeme unterliegen künftig strengen Auflagen. Beispiel Kreditvergabe: Laut KI-Gesetz dürfen Banken nicht allein die Maschine über die Bonität der Kundin oder des Kunden entscheiden lassen. Ein Mensch muss den maschinell errechneten Score prüfen und die Freigabe oder Ablehnung verantworten.

Hersteller solcher Hochrisikosysteme haben diese vor der Markteinführung gründlich zu testen, Importeure und nachgelagerte Händler müssen sich vergewissern, dass die Systeme dem Gesetz genügen, Anwender müssen den Einsatz überwachen. Letzte Entscheidungs- und Aufsichtsinstanz bleibt nach dem Gesetz der Mensch. Den Adressaten der Entscheidungen solcher Systeme verleiht die Verordnung Einspruchs-, Auskunfts- und Beschwerderechte. Zu den Hochrisikosystemen zählen insbesondere:

Klasse 3: Transparenzrisiko

Als moderat riskant, zumindest intransparent stuft der EU-Gesetzgeber eine KI ein, die zwar nicht mit Grundrechten kollidiert, die Nutzer aber über Art und Quellen des Angebots im Unklaren lässt. Das betrifft Chatbots, vor allem aber die sogenannte generative KI, das heißt Programme, die artifizielle Texte, Bilder oder Videos erzeugen (z.B. Deepfakes). Laut Gesetz müssen sich solche Apps als Maschinen zu erkennen geben, ihre Erzeugnisse als Artefakte kennzeichnen, Trainingsdaten und deren Quellen dokumentieren, die Urheberrechte der Quellen wahren und die Erzeugung illegaler Inhalte verhindern.

Klasse 4: Geringes Risiko

Keinerlei Einschränkungen gelten für einfache KI-Systeme wie Spamfilter oder Empfehlungsdienste.

Qualitätssicherung für KI-Anwendungen?

Lighthouz AI

Betreiber

Natürliche oder juristische Person (Behörde oder Unternehmen), die ein KI-System entwickelt oder entwickeln lässt, um es im eigenen Namen oder unter eigener Marke entgeltlich oder unentgeltlich zu ver- oder betreiben.

Einführer

In der Europäischen Union ansässige oder niedergelassene natürliche oder juristische Person, die ein KI-System, das den Namen oder die Marke eines außerhalb der EU ansässigen oder niedergelassenen Herstellers trägt, in der Union ver- oder betreibt. Pflichten:

Händler

Natürliche oder juristische Person, die ein von Dritten hergestelltes oder importiertes KI-System ohne Änderung seiner Merkmale innerhalb der EU vertreibt. Pflichten:

Nutzer

Natürliche oder juristische Person, die ein KI-System in Eigenregie zu beruflichen, kommerziellen oder amtlichen Zwecken einsetzt. Pflichten:

Bei der KI liegt der Akzent auf dem K, nicht auf dem I – die Maschine weiß nicht wirklich, was sie tut. Was bisher manchmal kurios, oft ärgerlich, peinlich, bisweilen schädlich war, wird nach dem Willen des EU-Gesetzgebers vor allem eines: illegal. Systeme, die mit der Menschenwürde spielen, müssen zügig ausrangiert werden. Als verantwortbar, aber riskant eingestufte KI-Anwendungen sind ständig zu beaufsichtigen.

Fehlfunktionen solcher Systeme aufzudecken, hat sich das US-Startup Lighthouz vorgenommen. Gemeinsam mit den amerikanischen Kolleginnen und Kollegen unterstützt Consileon Sie bei den gesetzlich vorgeschriebenen Tests. Lighthouz AI prüft KI-Systeme auf:

Im Kern testet Lighthouz AI generative KI, wie nahe die maschinell erzeugte Antwort auf eine komplexe Frage der Erwartung der Nutzerin oder des Nutzers kommt. Dazu bewertet Lighthouz AI das Ergebnis mit syntaktischen und semantischen Metriken.

Wenn Sie genau wissen möchten, wie das Testverfahren von Lighthouz AI funktioniert, was Sie dazu brauchen und wie es Ihnen hilft, die KI-Verordnung einzuhalten, freuen sich unsere KI-Experten auf Ihre Nachricht.

Qualitätssicherung für KI-Anwendungen?

Lighthouz AIConsileon hilft, KI-Anwendungen rechtssicher zu entwickeln, zu vermarkten oder einzusetzen sowie Altsysteme der neuen Rechtslage anzupassen.

„*“ zeigt erforderliche Felder an

Weitere Informationen zur KI-Verordnung finden Sie beim Europäischen Parlament. Einen kurzen Einstieg bietet ein Video des MDR.

Wie verändert KI die Softwareentwicklung? Experten von Consileon erklären Chancen, Grenzen und wie Unternehmen KI erfolgreich im Alltag einsetzen.

Regulatorik wird oft als Belastung gesehen, kann mit KI aber zum Innovationshebel werden. Unser Whitepaper „RegTech 2026“ zeigt, wie Banken mit KI den Compliance-Zyklus automatisiert, Anpassungen beschleunigt und neue Ertragschancen eröffnet, inklusive Use Cases und Business Case.

Consileon ist auf dem VÖB KI-Camp 2026 in Bonn vertreten und zeigt, wie Banken mit dem Consileon Compliance Manager ihre MaRisk-Dokumente und Prozesse KI-gestützt prüfen können. Im Fokus stehen regulatorische Sicherheit, nachvollziehbare Qualität und praxisnahe KI-Lösungen für die Finanzbranche.